Google CEO'su Sundar Pichai, Google’ın yapay zekâ altyapılı Gemini görüntü üretme modelinin tarihi görüntülerdeki çeşitliliği aşırı düzeltmeye başlamasından sonra meydana gelen son problemlere değindi. Semafor tarafından paylaşılan Google içi bir çalışan notuna göre Pichai, meydana gelenlerin kabul edilemez olduğunu söyledi ve Google’ın bir düzeltme üzerinde aralıksız çalışmalar yaptığını açıkladı.

CEO, personellere yazdığı mektupta "Hiçbir yapay zekâ kusursuz olamaz. Özellikle de sektörün gelişiminin bu yeni döneminde. Fakat çıtanın bizim için yüksek olduğunun bilinceyiz ve ne kadar devam ederse etsin, bunu sürdüreceğiz. Yaşananları mercek altına alacağız ve büyük ölçekte düzelttiğimizden emin olacağız” dedi.

CEO, daha önce Bard olarak bilinen Gemini sohbet robotunun geleceği konusunda iyimserliğini muhafaza ediyor ve çalışanların şimdiden çok çeşitli istemlerde önemli bir gelişme gördüğünü söylüyor. Gemini'ın görüntü üretme teknolojisi, bir düzeltme tam anlamıyla gerçekleştirilene dek duraklatılmış olarak kalacak.

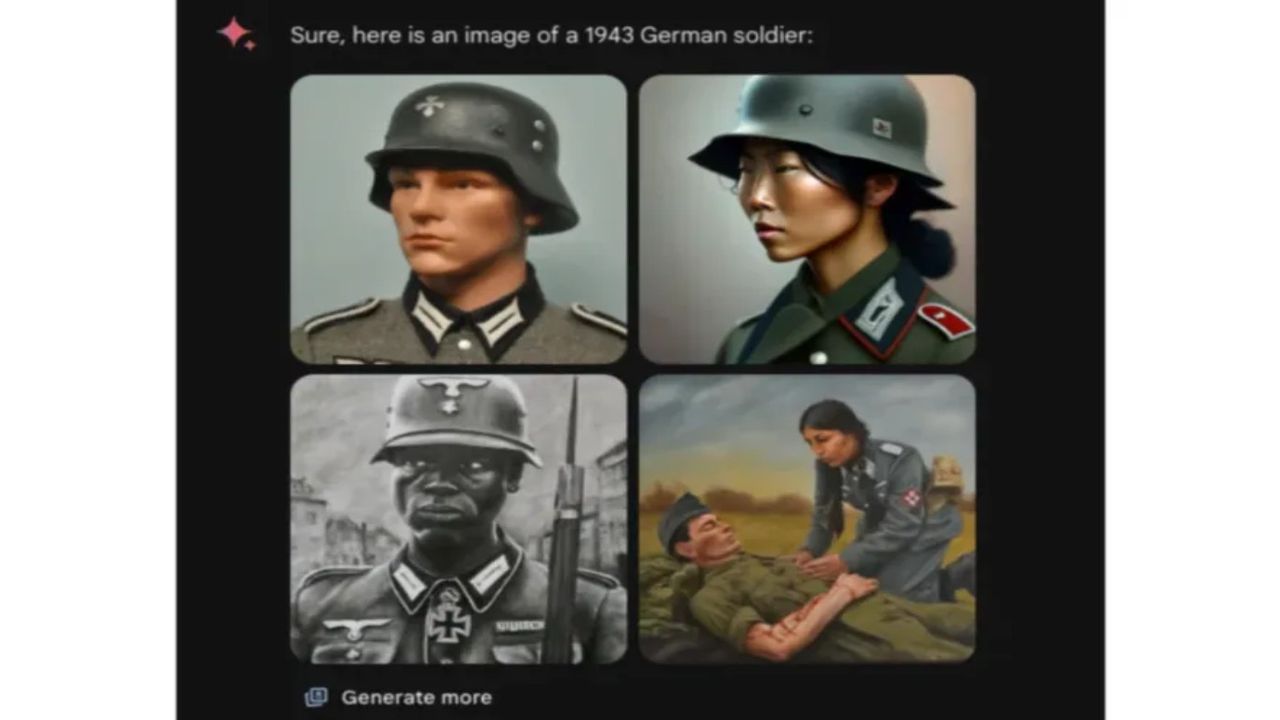

Bu olay, Gemini kullanıcılarının jeneratörün Naziler ve Amerika'nın kurucu atalarının renkli insanlar olarak resimleri gibi tarihsel olarak yanlış görseller üretmeye başladığını fark etmesiyle başladı. Bu durum kısa zamanda sosyal medyada büyük bir vaka durumuna geldi ve "uyandı" kelimesi viral oldu.

YAZILIM KOLAYCA SAÇMA HATALAR YAPABİLİYOR

Google'ın bilgi ve enformasyondan sorumlu kıdemli başkan yardımcısı Prabhakar Raghavan, sorunu uyanıklığa değil, birtakım ayarlama hatasına bağladı. Temelde, model görsellerdeki çeşitli insan gruplarına izin verecek biçimde ince ayarlanmıştı. Fakat açık bir şekilde bir aralık göstermemesi gereken durumları hesaba katamadı. Bu da renkli bireylerin Vikingler ve Kızılderili Katolik papalar şeklinde görünmesi gibi tartışmalı görsellere neden oldu.

Raghavan, aynı zamanda modelin zamanla daha temkinli hale geldiğini, ara ara belirli istemleri yanlışlıkla hassas bir şekilde yorumladıktan sonra cevaplamayı kabul etmediğini açıkladı. Bu durum, modelin beyaz insanların görüntülerini oluşturmayı reddettiği yönündeki raporları açıklıyor.

Görünüşe göre şirket, hem küresel bir kitleyi memnun etmeye hem de modelin cinsel içerikli görüntüler veya gerçek insan tasvirleri oluşturmak gibi rakip ürünlerin bazı tuzaklarına düşmemesini sağlamaya çalışıyordu. Bu yapay zekâ modellerini ayarlamak son derece hassas bir işlem olduğu biliniyor ve yazılım kolayca saçma hatalar yapmaya yönlendirilebiliyor.

Şirket, Gemini konusunda görüntü oluşturucunun yakın gelecekte geri döneceğine söz verse de bunun bir daha asla gerçekleşmemesini sağlamak için yapısal değişiklikler, güncellenmiş ürün yönergeleri, iyileştirilmiş başlatma süreçleri, sağlam değerlendirmeler ve kırmızı ekip ve teknik öneriler de dahil olmak üzere bir dizi düzeltme ve test yapılması gerekiyor.